Un estimado colega nos comparte un artículo que vincula el campo de las ciencias sociales y la inteligencia artificia (IA). El artículo fue escrito por Cody Mello-Klein y se publicó el 2 de junio de 2023 en la sección de Sociedad y Cultura del boletín de noticias (Global News) de la Northeastern University y lo tradujimos nosotros para este espacio. Veamos de quÉ se trata…

Blanca Nieves, Cenicienta y La Bella Durmiente tienen más en común que sus orígenes como figuras clásicas de cuentos de hadas y, ahora, parte de la famosa lista de personajes de Disney. Sus cuentos de hadas también están llenos de sesgos y estereotipos de género, según los estudiosos de la literatura, y ahora la Inteligencia Artificial.

Un equipo de investigadores de Northeastern University, University of California Los Angeles e IBM Research ha creado una plataforma de inteligencia artificial (IA) que puede analizar los libros de cuentos infantiles y detectar casos de sesgo de género. Su investigación ha sido publicada en el arXiv preprint server.

La forma en que los cuentos de hadas representan y enseñan lecciones, moral y roles socioculturales a los niños, particularmente a las niñas, se ha sido discutido en la academia y en otros ámbitos durante décadas. Estas historias están llenas de princesas que necesitan ser salvadas y príncipes guapos que están ahí para salvarlas.

La esperanza es que la herramienta similar a un corrector ortográfico impulsada por la plataforma de IA que creó este equipo sea utilizada por escritores y editores, así como por investigadores, para crear historias más inclusivas para niños, dice Dakuo Wang, profesor asociado de Northeastern y uno de los los investigadores del proyecto.

"Si en el futuro tengo una niña, no quiero que se sienta desanimada porque se supone debe “asumir esas tareas” o “conquistar esos desafíos”, [o] en otras palabras, alguien vendrá a salvarme o se supone que no es algo que debo hacer como niña", dice Wang. "Si podemos desarrollar una tecnología para detectar o marcar automáticamente ese tipo de sesgos y estereotipos de género, entonces al menos puede servir como barandal o red de seguridad no solo para los cuentos de hadas antiguos, sino también para las nuevas historias que se escriben y crean todos los días en la actualidad. "

Todo este trabajo comenzó como parte de la investigación en curso del equipo sobre cómo la IA puede ayudar a desarrollar habilidades de aprendizaje de idiomas para niños pequeños. El equipo ya estaba interesado en los cuentos de hadas como herramientas para el aprendizaje de idiomas y había recopilado cientos de historias de todo el mundo para usarlas como "corpus" para analizar su algoritmo.

Reclutaron a un grupo de expertos en educación (maestros y académicos) para revisar las historias y crear una lista de preguntas y respuestas que ayudarían a probar si un niño estaba aprendiendo de estas historias. El resultado final fue 10,000 pares de preguntas y respuestas, y la comprensión de que todas estas historias, sin importar de dónde vinieran, tenían estereotipos de género "obstinados y profundos".

La princesa come una manzana envenenada, es encarcelada, secuestrada o maldecida o muere y no tiene ningún medio para cambiar su situación.

Mientras tanto, los personajes masculinos, príncipes, reyes y héroes, estaban matando dragones, rompiendo las maldiciones y salvando a la princesa.

Investigaciones anteriores en esta área se centraron en lo que Wang llama el "nivel superficial" de sesgo. Eso significó analizar historias e identificar parejas de palabras o frases, como "príncipe" y "valiente", que conectan ideas e identidades de maneras específicas. Pero Wang y el resto del equipo querían profundizar más.

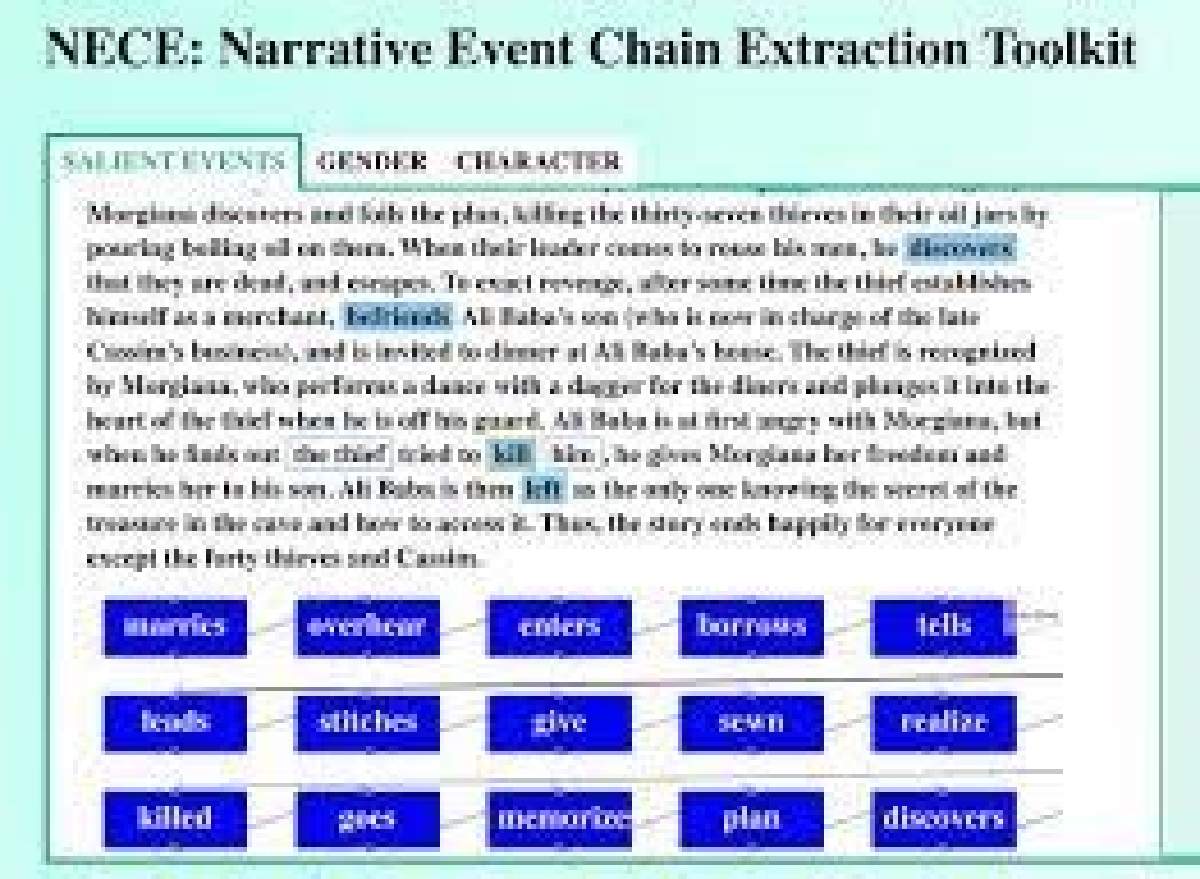

Se centraron en "cadenas de eventos narrativos temporales", la combinación específica y el orden de eventos y acciones que experimenta o realiza un personaje.

"En realidad, es la experiencia y la acción lo que define quién es esta persona, y esas acciones influyen en nuestros lectores sobre lo que [ellos] deben o no deben hacer para imitar a ese personaje ficticio", dice Wang.

Usando los cientos de historias que habían recopilado, el equipo creó procesos automatizados para extraer los nombres y géneros de los personajes junto con cada evento. Luego alinearon esos eventos como una cadena para cada personaje. También automatizaron un proceso para agrupar eventos y acciones por categorías específicas. Cada evento se analizó y se le asignó una razón de probabilidades, con qué frecuencia estaba conectado a un personaje masculino o femenino.

De los 33,577 eventos analizados en el estudio, el 69% fueron atribuidos a personajes masculinos y el 31% a personajes femeninos. Los eventos asociados con los personajes femeninos a menudo estaban relacionados con tareas domésticas como arreglarse, limpiar, cocinar y coser, mientras que los de los personajes masculinos estaban relacionados con el fracaso, el éxito o la agresión.

Con toda esa información, Wang y el equipo crearon una herramienta de procesamiento de lenguaje natural que podría ir más allá del análisis de eventos individuales para encontrar sesgos en las cadenas de eventos.

"Alguien está siendo salvado y luego se casa y luego vive feliz para siempre; otros mataron al monstruo, salvaron a la princesa y vivieron felices para siempre", dice Wang. "No es la parte de 'vivieron felices para siempre' o la parte de 'casarse' las que son diferentes. En realidad, son los eventos que suceden antes de estos eventos en una cadena los que marcan la diferencia".

Al automatizar este proceso, Wang dice que espera que la herramienta encuentre uso entre personas ajenas a la comunidad de investigación que realmente están creando, o recreando, estas historias. En el proceso, pueden comenzar a evitar que las historias transmitan estas ideas obsoletas y dañinas a la próxima generación.

"Con nuestra herramienta, simplemente pueden cargar su primer borrador en una herramienta como esta y debería generar algún puntaje o medidor que indique: "Aquí están las cosas que puede o no desea verificar". Si esta intención no es lo que le gustaría expresar, entonces tal vez debería pensar en una reescritura. Aquí hay algunas sugerencias'", dice Wang.

En el futuro, Wang y el equipo planean expandir su trabajo para analizar otras formas de sesgo. También usarán su herramienta para evaluar los sesgos de otra IA. Esperan usar su algoritmo para analizar si ChatGPT tiene los mismos sesgos y estereotipos de género cuando crea contenido basado en estas historias.

"Estamos proponiendo que esta es en realidad una tarea, una tarea que la comunidad técnica realmente puede ayudar a conquistar", dice Wang. "No decimos que nuestro método sea el mejor. Solo decimos que nuestro método es el primero en realizar esta tarea, y esta tarea es tan predominante. Tal vez deberíamos centrar parte de nuestra atención en estos desafíos y tareas sociales existentes. "

Fuente: https://news.northeastern.edu/2023/06/01/gender-childrens-books-bias-ai/